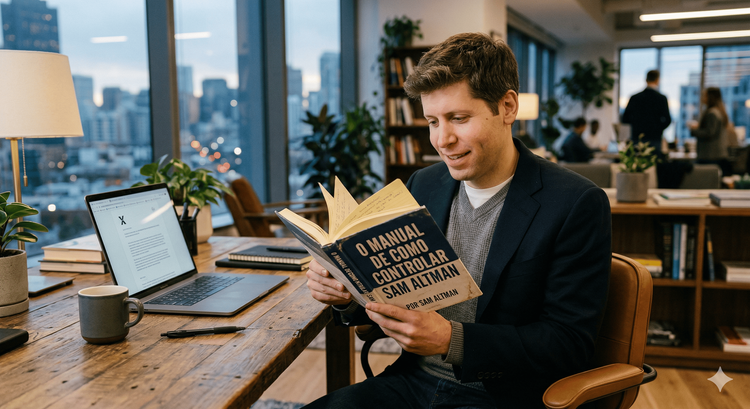

Sam Altman acabou de publicar o manual de como controlar Sam Altman

Sobre o paradoxo de vender o antídoto do próprio veneno — e por que política industrial séria não pode ser escrita por quem vai ser regulado por ela.

Crédito: Gemini

, redator(a) da StartSe

23 min

•

13 abr 2026

•

Atualizado: 13 abr 2026

newsletter

Start Seu dia:

A Newsletter do AGORA!

Na mesma semana em que a New Yorker publicou uma investigação devastadora sobre Sam Altman, a OpenAI lançou um documento chamado Industrial Policy for the Intelligence Age: Ideas to Keep People First.

Coincidência? Talvez. Distração? Gary Marcus, um dos críticos mais consistentes de Altman, foi direto ao ponto: o relatório é mais uma tentativa altmaniana de mudar o assunto. Desta vez, do IPO iminente, da economia quebrada da empresa e da reportagem que está circulando.

Eu li os dois documentos lado a lado. A conclusão é mais desconfortável do que parece.

O documento da OpenAI é um manual muito bem escrito sobre como controlar empresas como a OpenAI — e pessoas como Sam Altman. O problema é quem está escrevendo o manual. E o problema maior é perceber que praticamente nenhuma das propostas se aplica à própria OpenAI, e que várias delas descrevem, com precisão cirúrgica, salvaguardas que a empresa já prometeu no passado e já quebrou.

O que a reportagem mostrou

A apuração de Ronan Farrow e Andrew Marantz é baseada em mais de cem entrevistas, em cerca de setenta páginas de mensagens internas compiladas por Ilya Sutskever (os chamados Memorandos de Ilya, que adquiriram status lendário no Vale do Silício) e em mais de duzentas páginas de anotações pessoais e documentos reunidos por Dario Amodei ao longo de anos sob o título "Minha Experiência com a OpenAI".

Os fatos concretos que saltam do texto são estes.

Em dezembro de 2022, Altman teria garantido ao conselho da OpenAI que uma série de recursos controversos do GPT-4 — entre eles o ajuste fino pelo usuário e o deployment como assistente pessoal — tinha sido aprovada pelo comitê de segurança. A conselheira Helen Toner pediu a documentação. Descobriu que não tinha sido. Na mesma reunião, funcionários revelaram a outra conselheira que a Microsoft tinha lançado uma versão do ChatGPT na Índia sem completar a revisão de segurança obrigatória. Nas palavras do pesquisador Jacob Hilton, isso foi simplesmente ignorado.

Em 2023, segundo os Memorandos de Ilya, Altman teria dito a Mira Murati, então CTO, que o modelo GPT-4 Turbo não precisava de aprovação de segurança, citando o consultor jurídico Jason Kwon. Quando Murati foi conferir diretamente com Kwon pelo Slack, a resposta dele foi: confuso de onde o Sam tirou essa impressão.

Esses são dois episódios documentados de um executivo que, segundo vários colegas citados na reportagem, teria um padrão de representar como aprovados processos de segurança que não aconteceram.

A reportagem também revela uma promessa quebrada que importa muito para qualquer discussão sobre compromissos públicos de empresas de IA. Quando a OpenAI anunciou a criação da equipe de superalinhamento, liderada por Sutskever e Jan Leike, prometeu publicamente destinar 20% do poder computacional reservado da empresa ao esforço. Quatro pessoas que trabalharam na equipe disseram aos repórteres que os recursos reais foram de 1% a 2%, e nos chips mais antigos e mais fracos. Leike reclamou com Murati, que o aconselhou a parar de insistir porque o compromisso nunca havia sido realista.

A equipe de superalinhamento foi dissolvida antes de concluir sua missão. A equipe de preparação para AGI também foi dissolvida. O formulário mais recente da OpenAI para o IRS removeu "segurança" da descrição de suas atividades significativas. Quando os repórteres pediram para entrevistar pesquisadores da OpenAI que trabalhavam com segurança existencial, um representante da empresa respondeu que não sabia do que se tratava — que isso não existe.

Há ainda a investigação da WilmerHale. Após a demissão e a reintegração de Altman em novembro de 2023 — o episódio que dentro da empresa virou conhecido como "o Estalo" — os conselheiros que saíram exigiram uma investigação externa independente. A OpenAI contratou o escritório que já tinha apurado Enron e WorldCom. Seis pessoas próximas à investigação disseram aos repórteres que ela parecia desenhada para limitar transparência. Os investigadores inicialmente não entrevistaram figuras-chave. O escopo foi restrito aos eventos da demissão, e não ao histórico de integridade. Nenhum relatório escrito foi produzido — apenas apresentações orais, por recomendação dos advogados pessoais dos dois novos conselheiros que supervisionavam a revisão. A empresa divulgou cerca de oitocentas palavras em seu site. Uma fonte próxima à apuração disse que tudo indicava que eles queriam chegar a um resultado específico, que era absolvê-lo.

Sobre esse material todo, a síntese mais direta veio do próprio Amodei, em suas anotações, hoje um dos principais concorrentes da OpenAI como CEO da Anthropic: "O problema com a OpenAI é o próprio Sam".

Esse é o pano de fundo. Agora olha o que a OpenAI publicou três dias depois.

O que o documento propõe

O Industrial Policy for the Intelligence Age é, na superfície, um texto impecável. Bem escrito, bem estruturado, bem intencionado. Propõe um conjunto ambicioso de ideias para manter pessoas no centro da transição para a superinteligência.

São propostas que eu, sinceramente, acho que precisamos discutir. Voz dos trabalhadores na implementação de IA. Tributação sobre capital e sobre trabalho automatizado para sustentar a rede de proteção social. Um Public Wealth Fund que daria a todo cidadão uma fatia direta do crescimento gerado pela IA. Benefícios portáteis. Semana de quatro dias financiada pelos ganhos de produtividade. Regimes de auditoria para modelos de fronteira. Governança corporativa alinhada à missão, no modelo Public Benefit Corporation. Mecanismos estruturados de input público sobre alinhamento. Reporte obrigatório de incidentes e quase-acidentes a uma autoridade pública.

Tudo razoável. Tudo urgente. Tudo importante.

Só tem um detalhe.

Leia de novo, com a reportagem ao lado

Cada uma dessas propostas, quando você sobrepõe à apuração da New Yorker, deixa de ser uma ideia de política pública e vira uma descrição precisa do que está faltando dentro da própria OpenAI. Em vários casos, é uma descrição de salvaguardas que a própria OpenAI já prometeu e já abandonou.

O documento propõe "endurecer sistemas de fronteira contra captura corporativa ou de insiders". A acusação central dos Memorandos de Ilya, ratificada por mais de cem fontes ouvidas pela reportagem, é que Altman capturou conselhos, narrativas e processos internos para concentrar decisão. O ex-pesquisador Carroll Wainwright resumiu o padrão: Altman aceita estruturas que, no papel, limitariam seu poder no futuro; quando o futuro chega, ele se livra delas.

O documento propõe Public Benefit Corporations com governança alinhada à missão. A OpenAI nasceu como organização sem fins lucrativos com missão explícita, se converteu em empresa de "lucro limitado" controlada pela fundação, e em outubro passado se recapitalizou como entidade com fins lucrativos. A fundação sem fins lucrativos associada hoje detém 26% das ações, e os membros do conselho da fundação são, com uma exceção, os mesmos membros do conselho da empresa com fins lucrativos. A empresa se prepara para um IPO que deve avaliá-la em cerca de um trilhão de dólares.

O documento propõe reporte obrigatório de incidentes e near-misses a uma autoridade pública. A reportagem descreve, nome a nome, Altman omitindo do próprio conselho informações sobre falhas em processos de segurança de modelos específicos. A revisão sobre seu próprio comportamento foi conduzida sem relatório escrito.

O documento propõe mecanismos de input público sobre alinhamento, "para que alinhamento não seja definido só por engenheiros ou executivos a portas fechadas". Em 2025, a OpenAI enviou uma intimação judicial para um advogado de 29 anos chamado Nathan Calvin, que trabalha numa organização sem fins lucrativos chamada Encode e tinha ajudado a redigir um projeto de lei de segurança de IA no Senado da Califórnia. A intimação exigia todas as comunicações privadas dele sobre o projeto. Outros apoiadores do projeto e críticos da reestruturação comercial da empresa também foram intimados. Don Howard, que dirige a Fundação James Irvine, descreveu o padrão como intimidação para calar apoiadores de regulação. A OpenAI afirma que era processo legal padrão.

O documento propõe regimes de auditoria para modelos de fronteira. A OpenAI já prometeu publicamente destinar 20% do compute ao alinhamento. Entregou de 1% a 2%. Anunciou uma equipe de superalinhamento e dissolveu. Anunciou uma equipe de preparação para AGI e dissolveu. Em 2023, a empresa contratou o escritório responsável pelas investigações da Enron e da WorldCom para apurar acusações contra seu CEO — e a apuração foi conduzida sem relatório escrito, com investigadores que, segundo seis fontes, pareciam ter um veredito pré-determinado.

O documento propõe voz dos trabalhadores na implementação de IA. A reportagem documenta cerca de uma dúzia de engenheiros seniores da OpenAI se reunindo em segredo para discutir se os próprios fundadores eram confiáveis. Em uma das reuniões, um deles lembrou de um esquete da dupla britânica Mitchell e Webb — o soldado nazista perguntando se eles eram os vilões. Sutskever, Leike, os irmãos Amodei, Murati, Wainwright, Hilton, Clark, Hedley. A lista de dissidentes internos que saíram ou foram deslocados é longa e técnica. Quase todos os nomes relevantes em segurança e política da fase inicial da empresa hoje estão fora.

O documento propõe que governos implementem regulação de senso comum para IA, "não para beneficiar incumbentes mas para proteger crianças e mitigar riscos de segurança nacional". Em 2023, Altman testemunhou no Senado americano propondo uma nova agência federal para supervisionar modelos avançados. No mesmo período, a OpenAI fazia lobby para enfraquecer a regulamentação da União Europeia, conforme a Time reportou. Em 2024, a empresa se opôs publicamente ao projeto de lei SB de segurança de IA da Califórnia, enquanto aliados pressionavam Pelosi e Newsom por veto. Em 2025, Greg Brockman prometeu cinquenta milhões de dólares ao Leading the Future, um super PAC criado especificamente para derrotar candidatos ao Congresso favoráveis à regulação de IA. A OpenAI diz que não contribui para o super PAC. Brockman contribui.

O documento propõe que data centers de IA "gerem empregos e receita tributária locais". A visão atual da OpenAI para infraestrutura envolve o projeto Stargate, anunciado na Sala Roosevelt no segundo dia do mandato Trump, e um campus de data centers em Abu Dhabi sete vezes maior que o Central Park, consumindo aproximadamente a mesma energia que a cidade de Miami. A reportagem cita um ex-executivo da OpenAI descrevendo o conjunto desses projetos como "a coisa mais imprudente que já foi feita".

O documento propõe "sistemas de segurança para riscos emergentes" e responsabilização quando o dano ocorrer. A OpenAI enfrenta atualmente sete ações judiciais por homicídio culposo, alegando que o ChatGPT induziu vários suicídios e um assassinato. Os registros de um dos casos mostram o modelo reforçando a paranoia de um homem sobre a mãe de 83 anos até ele matá-la. A empresa contesta as ações e diz que continua aprimorando salvaguardas.

Dá para continuar. Eu parei aqui por generosidade.

O padrão: criar o problema, vender a solução, terceirizar a execução

É aqui que a coisa vira tese.

O documento da OpenAI é cuidadosamente escrito no modo imperativo impessoal. "Governos deveriam." "Políticas deveriam." "Instituições deveriam." Não tem um único compromisso em primeira pessoa. Nenhuma proposta que comece com "a OpenAI vai". Nenhum cronograma. Nenhuma meta auditável. Nenhuma entrega que a empresa esteja dizendo que vai fazer e pela qual possa ser cobrada.

É um documento sobre o que os outros deveriam fazer para domar a tecnologia que a OpenAI está construindo — na velocidade em que a OpenAI escolher construir, com o tipo de transparência que a OpenAI escolher oferecer, e com o tipo de revisão independente que, quando exigida, é conduzida sem relatório escrito.

Isso é uma jogada retórica antiga, e eu vou chamar pelo nome: é o movimento do incendiário que vende extintores. Você cria a condição, depois publica o manual de combate ao incêndio, e ainda sai na foto como o bombeiro iluminado.

Repare na estrutura do argumento implícito. Primeiro: a superinteligência está chegando e vai desestabilizar tudo. Segundo: aqui está uma lista corajosa de políticas públicas que a sociedade deveria adotar para lidar com isso. Terceiro — e aqui é que é bonito — a execução dessas políticas é responsabilidade de governos, sindicatos, instituições multilaterais e da "sociedade civil em diálogo democrático". A OpenAI, enquanto isso, continua construindo a coisa que está gerando o problema, exatamente na velocidade que decidir.

O que sobra para a OpenAI no documento? Uma linha: adotar governança de Public Benefit Corp. Exatamente o modelo do qual ela acabou de se afastar na recapitalização de outubro.

Vale lembrar uma frase que um ex-funcionário atribui ao próprio Altman, reportada textualmente por Farrow e Marantz: Altman teria dito a um colega, em particular, que não se importa com dinheiro, que se importa mais com poder. É possível discutir se isso é recorte injusto. É difícil discutir que o padrão de comportamento descrito na reportagem é inteiramente consistente com essa declaração.

Por que isso importa para quem lidera

Eu trabalho todos os dias com líderes que precisam decidir, nos próximos doze meses, quanto confiar em quem na corrida de IA. Quais modelos adotar. Quais fornecedores tratar como parceiros estratégicos. Em quem apostar quando o assunto é o dado crítico da sua empresa, o pipeline comercial, a governança do board, a estratégia de longo prazo.

Esse é o ponto em que política industrial deixa de ser debate abstrato de policy wonks em Washington e vira risco fiduciário.

A pergunta que a reportagem faz não é "Altman é uma pessoa má". A pergunta é mais precisa e mais perturbadora: o padrão de comportamento que mais de cem pessoas próximas a ele descrevem é compatível com o nível de poder e de confiança que esse cargo exige?

A resposta que o documento da OpenAI dá, sem perceber que está dando, é que não.

Porque se as salvaguardas que a própria OpenAI lista como necessárias para a era da superinteligência são salvaguardas que a própria OpenAI não aplica a si mesma — e em vários casos já prometeu aplicar, já abandonou e foi pega abandonando — uma de duas coisas é verdade. Ou o documento é performático e a OpenAI não acredita nele de fato. Ou o documento é sincero e a OpenAI está admitindo, nas entrelinhas, que é exatamente o tipo de ator que precisa ser controlado por instituições externas que ainda não existem.

Nenhuma das duas leituras é confortável. E nenhuma das duas leituras recomenda entregar a um único executivo as decisões unilaterais sobre como e quando lançar o próximo modelo.

O que fazer com tudo isso

Eu não estou propondo que a gente pare de usar os modelos da OpenAI amanhã. Isso seria ingênuo e contraproducente. Estou propondo três coisas mais baratas e mais inteligentes.

Primeiro: leia o documento. Ele é genuinamente bom. As ideias sobre Public Wealth Fund, benefícios portáteis, voz dos trabalhadores, auditoria de modelos de fronteira e tributação do trabalho automatizado são pautas que qualquer líder sério precisa entender para os próximos cinco anos. Use o documento pelo que ele tem de melhor, que é um mapa de discussão.

Segundo: leia a reportagem ao lado. Não como fofoca corporativa. Como estudo de caso sobre o que acontece quando poder tecnológico se concentra mais rápido do que as instituições capazes de fiscalizá-lo. É o tipo de leitura que muda a forma como você estrutura o seu próprio board, as suas próprias cláusulas contratuais, as suas próprias políticas de governança de IA.

Terceiro: exija reciprocidade. Toda vez que um fornecedor de IA — qualquer um, não só a OpenAI — publica um manifesto sobre "IA responsável", a pergunta certa é uma só: o que exatamente você está se comprometendo a fazer, em que prazo, e como eu vou medir? Se a resposta for "outros deveriam", o manifesto é marketing. E marketing é uma coisa legítima, desde que a gente saiba que é marketing.

Altman escreveu um bom texto sobre como domar Altman. Cabe a nós, que estamos do outro lado da tela, decidir se vamos ler o texto como proposta ou como confissão.

Eu li como confissão. E acho que é hora da gente começar a ler assim também.

Este texto cruza duas publicações da primeira quinzena de abril de 2026: o documento "Industrial Policy for the Intelligence Age: Ideas to Keep People First", publicado pela OpenAI, e a reportagem "Moment of Truth: Sam Altman May Control Our Future — Can He Be Trusted?", assinada por Ronan Farrow e Andrew Marantz na edição impressa de 13 de abril de 2026 da New Yorker.

Gostou deste conteúdo? Deixa que a gente te avisa quando surgirem assuntos relacionados!

Leia o próximo artigo

newsletter

Start Seu dia:

A Newsletter do AGORA!